AI 大模型开发

AI 大模型开发20 分钟

分类下的全部文章

AI 大模型开发

AI 大模型开发 AI 大模型开发

AI 大模型开发 AI 大模型开发

AI 大模型开发 AI 大模型开发

AI 大模型开发 AI 大模型开发

AI 大模型开发 AI 大模型开发

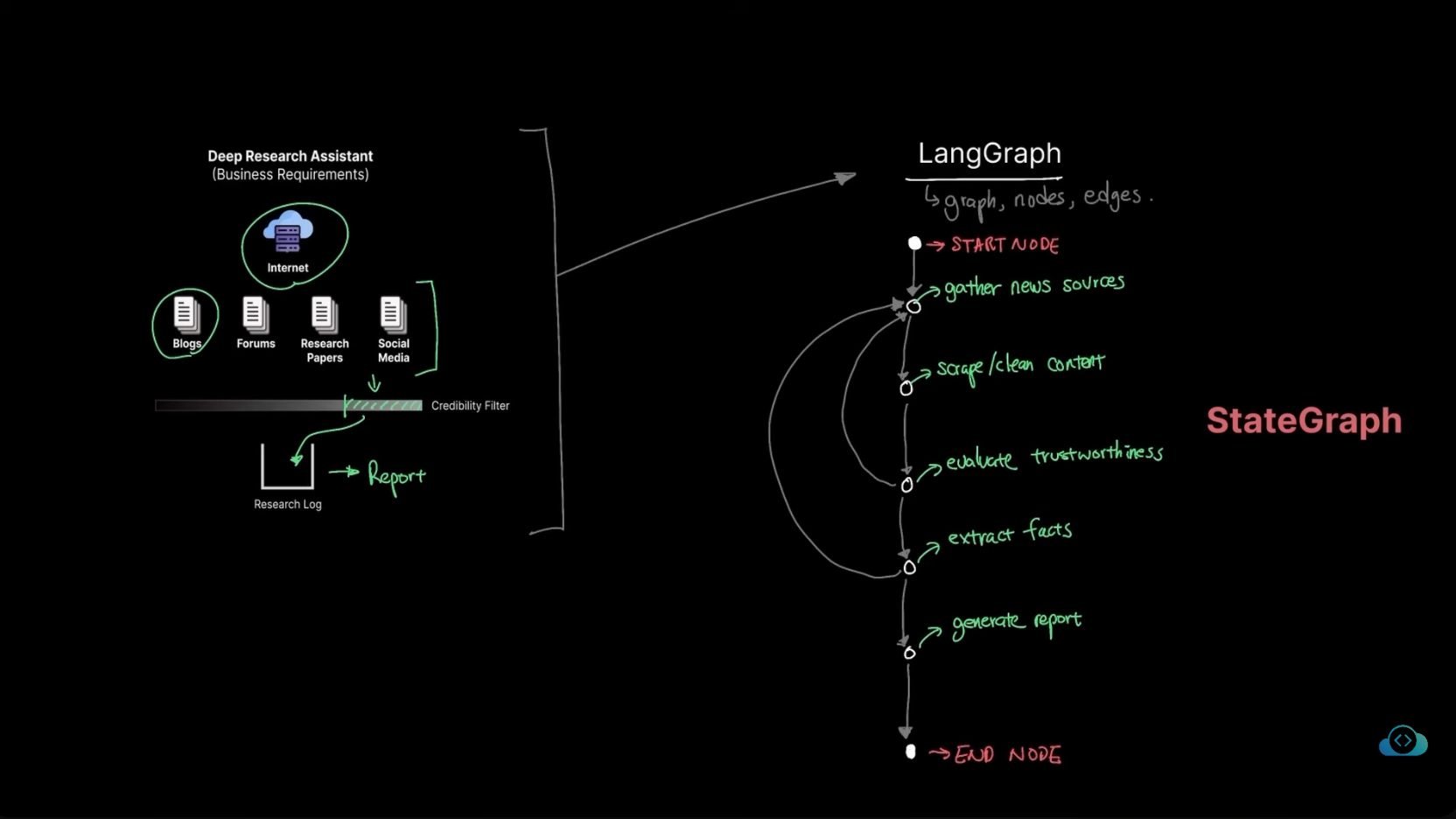

AI 大模型开发![[转]LangGraph完整指南](https://cdn.jacin.me/public/2026/04/b6f169b921a903d921d20e584751d438-1775490302585.png) AI 大模型开发

AI 大模型开发https://github.com/sickn33/antigravity-awesome-skills |工具|Skills 文件夹正确名称|说明| | --- | --- | --- | |**Codex App / Codex CLI**(OpenAI)|**.agents/skills**(**复数** agents)|官方标准| |**Antigravity**(Google)|**.agent/skills**(**单数…

AI 大模型开发

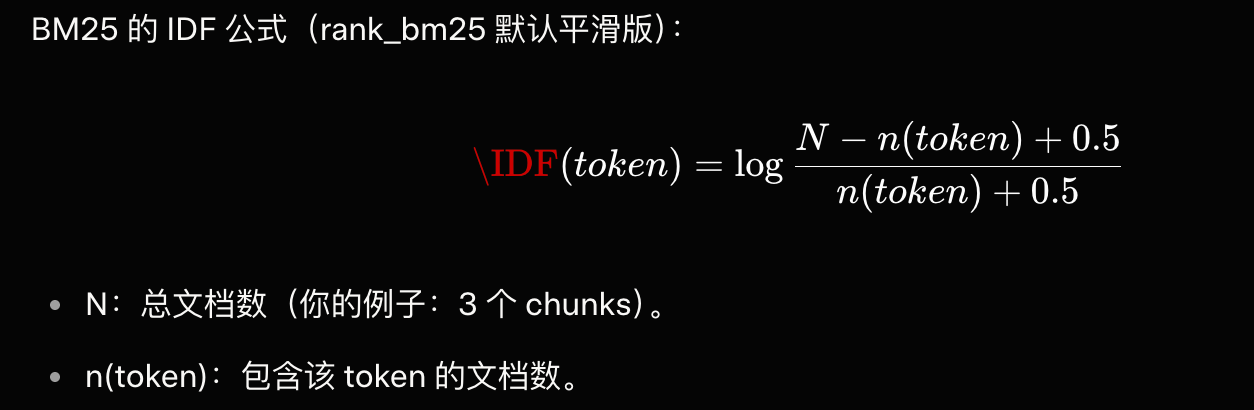

AI 大模型开发完整的中文 RAG 稀疏检索原型:**先切块 → 分词 → 建 BM25 索引 → 查询匹配**。本文通过一个可运行的 Python 示例,逐步拆解每个环节的原理与实现细节。 --- 整体流程概览 🔍 稀疏检索(Sparse Retrieval)的核心思路是:将文档和查询都表示为**高维稀疏向量**(大部分维度为 0,只有出现的词对应维度非零),然后通过向量相似度(本质是加权关键词匹配)完成检索。BM25 是最经典的稀疏检索算法。 整…